Künstliche Intelligenz verstehen – von AI zur XAI

Werkzeuge künstlicher Intelligenz (KI) haben mittlerweile in verschiedenste Unternehmensbereiche Einzug gehalten. Neben einer Reihe von Vorteilen, lassen sich allerdings auch verschiedenste Risiken und Hindernisse erkennen, die es zu bewältigen gilt. Erklärbare KI (XAI) ist dabei eine Möglichkeit Potenziale künstlicher und menschlicher Intelligenz zielführend zu realisieren.

30.10.2025

KI – Grundlagen, Chancen und Risiken

KI wird seit den 1960ern diskutiert und hat spätestens seit dem breiten Erfolg von ChatGPT grosse Aufmerksamkeit erfahren. Sie umfasst Technologien, die maschinellem Lernen (ML) ermöglichen, Erkenntnisse aus Daten zu gewinnen und Strukturen zu identifizieren. Dabei sind verschiedene definitorische Klassifikationen anwendbar. Eine starke KI versucht die breite Palette human-kognitiver Fähigkeiten abzudecken, während schwache KI auf spezifische Aufgaben fokussiert (Harwardt & Köhler, 2023). Ähnlich differenziert ein anderer Ansatz zwischen Artificial Narrow Intelligence (ANI), die auf spezifische Aufgaben trainiert ist, Artificial General Intelligence (AGI), die menschlicher Leistungsfähigkeit nahekommt und Artificial Super Intelligence (ASI), die diese übersteigt.

ANI wird innerhalb verschiedenster organisatorischer Sphären umfassend eingesetzt und hilft dabei Arbeitsprozesse sowohl effektiver als auch effizienter zu gestalten. Im B2B-Vertrieb ermöglicht ANI beispielsweise prädiktives Lead Scoring, automatisierte Kundensegmentierung oder personalisierte Angebotsgestaltung. Im Marketing kommt ANI insbesondere im Bereich des Programmatic Advertising zum Einsatz. Algorithmen optimieren in Echtzeit die Platzierung digitaler Werbeanzeigen auf Grundlage von Nutzerdaten, wodurch Streuverluste reduziert und Conversion Rates erhöht werden. Auch im Personalwesen gewinnt ANI zunehmend an Bedeutung. KI-gestützte Tools wie HireVue oder Pymetrics analysieren Bewerbungsunterlagen, Videointerviews oder kognitive Tests, um erste Vorauswahlen im Recruiting-Prozess zu treffen. In der Produktion und Logistik findet ANI Anwendung in der Predictive Maintenance von Maschinen, wo Sensor- und Prozessdaten kontinuierlich ausgewertet werden, um Ausfälle frühzeitig zu erkennen und ungeplante Stillstände zu vermeiden. In der Lieferkettenoptimierung analysieren Systeme wie Blue Yonder oder o9 Solutions Nachfrageprognosen, Lagerbestände und Transportwege, um Kosten zu senken und Reaktionsfähigkeit zu steigern. Banken und Zahlungsdienstleister wie PayPal oder Mastercard setzen ML-Modelle ein, um verdächtige Transaktionsmuster in Echtzeit zu identifizieren und Risiken zu minimieren.

Die grossen Potenziale und Vorteile der Anwendung künstlicher Intelligenz führen allerdings zu verschiedenen, mitunter noch nicht vollkommen absehbaren, Gefahren, wie teils negative Auswirkungen auf das menschliche Denken, Verzerrungen, Bias und Diskriminierungen, Datenschutzproblematiken oder technische Verwundbarkeiten von Organisationen durch bspw. Prompt Injection, bei denen manipulative Eingaben falsche Ergebnisse hervorrufen, sensible Daten preisgeben oder interne Strategien offenlegen können. Da Modelle primär auf Korrelationen beruhen, fehlt ihnen kausales Verständnis, was zu Fehlentscheidungen führen kann. Auch funktionieren viele Systeme als Black Boxes, deren Entscheidungen schwer nachvollziehbar sind, was Vertrauen und Akzeptanz einschränkt.

XAI und Ko-Intelligenz

Um diesen Herausforderungen zu begegnen, gewinnt das Feld der XAI an Bedeutung. Ziel dabei ist es, Modelle versteh- und nachvollziehbar zu machen, Verzerrungen zu erkennen, Prognosen zu validieren und KI-gestützte Prozesse gezielt zu verbessern. Auf diese Art und Weise wird es möglich nachhaltige Effekte zu erzielen und Digitainability auf einer Fähigkeitsebene zu etablieren.

Als zentrales Element verantwortungsvoller KI-Nutzung bringt sie Systeme mit ethischen, regulatorischen und praktischen Standards in Einklang. Verschiedenste Ansätze betonen dabei die vier normativen Prinzipien Fairness, Datenschutz, Transparenz und Erklärbarkeit. So soll XAI Diskriminierung vermeiden und gerechte Ergebnisse für unterschiedliche demografische und sozioökonomische Gruppen sicherstellen. Auch wird die Einhaltung rechtlicher Vorgaben und der Schutz sensibler Daten vor Missbrauch und unbefugtem Zugriff gewährleistet. XAI soll nachvollziehbare Informationen über Entscheidungsprozesse bereitstellen, sodass diese objektiv und subjektiv prüfbar werden und darüber hinaus Entscheidungen für Menschen verständlich sind, wodurch Aufsicht und Rechenschaftspflicht unterstützt werden.

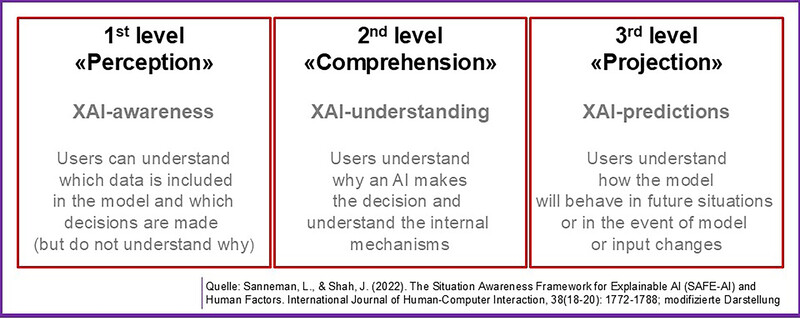

Das SAFE-AI-Framework (Sanneman & Shah, 2022) definiert drei Stufen der Erklärbarkeit und operationalisiert XAI (vgl. Abb.). XAI-Awareness ermöglicht es Nutzenden zu erkennen, welche Eingaben und Ausgaben das System berücksichtigt. So zeigt bspw. in der Personalabteilung ein Bewerber-Screening-Tool, dass für die Bewertung eines Kandidaten die Ausbildung, Berufserfahrung und Testergebnisse herangezogen werden. XAI-Understanding ermöglicht das Verständnis einzelner Entscheidungen, etwa warum etwas als besonders relevant eingestuft wird, während es die umfassendste Stufe, XAI-Predictions, erlaubt, die Wirkungen veränderter Schlüsselfaktoren auf Prognosen oder Priorisierungen nachzuvollziehen womit Logiken und Vorgänge analysierbar werden. Ein Beispiel für die zweite Stufe ist, das Verständnis dafür, dass ein Kandidat dann als besonders geeignet eingestuft wird, weil er in den letzten Projekten relevante Führungserfahrung gesammelt und herausragende Testergebnisse erzielt hat, während in der dritten Stufe der Nutzer Auswirkungen von Zertifikaten auf die Einstufungswahrscheinlichkeit eines Kandidaten innerhalb des XAI Systems vorhersehen und abschätzen kann.

Trotz ihres Potenzials bleibt der praktische Einsatz vieler XAI-Techniken eingeschränkt. Herausforderungen ergeben sich u.a. durch das Fehlen einheitlicher Standards bzw. von Ausbildungs- und Entwicklungsmöglichkeiten.

Am Institut für Organisation und Leadership der OST

Die erfolgreiche Implementierung von KI und XAI erfordert neben technologischem Know-how auch Verständnis für organisatorische und menschliche Faktoren. Der CAS Hybride, nachhaltige Unternehmenstransformation an der OST – Ostschweizer Fachhochschule vermittelt Methoden, um digitale Transformation und nachhaltige Entwicklung als wechselseitig verstärkende Prozesse umzusetzen. Das KI Bootcamp bietet praxisorientierte Einblicke in die Integration von KI-Systemen, einschliesslich Change-Management, Prozessanpassungen und XAI-gestützter Entscheidungsfindung. Beide Programme verbinden technisches Wissen, Führungskompetenzen und organisatorisches Handlungswissen für verantwortungsvolle KI-Nutzung und Ko-Intelligenz im Unternehmen.

Quellen

Harwardt, M., & Köhler, M. (2023). Künstliche Intelligenz entlang der Customer Journey. Wiesbaden: Springer.

Sanneman, L., & Shah, J. (2022). The Situation Awareness Framework for Explainable AI (SAFE-AI) and Human Factors. International Journal of Human-Computer Interaction, 38(18-20): 1772-1788.

Ansprechsperson

Dr. Ronald Ivancic, Mag. mult

IOL Institut für Organisation und Leadership Dozent

+41 58 257 17 39 ronald.ivancic@ost.ch